인공지능은 암호 숫자 모음

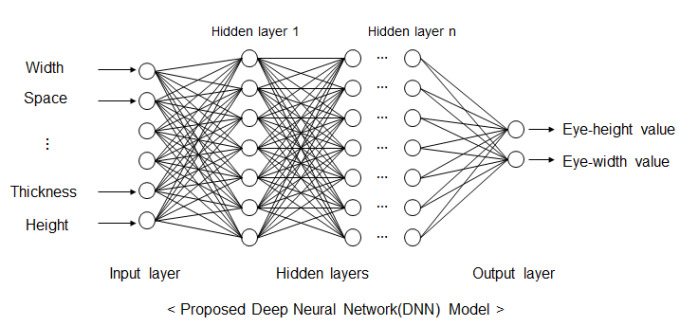

인공지능의 알고리즘 중에서 최근 가장 많이 사용하는 알고리즘이 딥러닝(DNN, Deep Neural Network)이라고 한다. 인간의 뇌 신경망을 모방해서 수학적 모델을 세우고 컴퓨터 코딩으로 구현한다.

이 딥러닝 신경망은 여러 개의 층(Layer)으로 이루어져 있는데, 그 층 숫자가 증가할수록 성능과 정확성이 높아진다. 그래서 "깊다"라는 의미를 가진 '딥'(Deep)이라는 표현이 나온다. 다른 말로 딥러닝을 심층학습(深層學習)이라고 부르기도 한다. 다량의 데이터나 복잡한 자료들 속에서 핵심적인 내용 또는 기능을 추출해내는 기계학습(Machine Learning) 알고리즘의 일종이다.

기계학습은 큰 틀에서 사람의 사고방식을 컴퓨터에게 가르치는 분야라고 이야기할 수 있다. 이 딥러닝이 성공할 수 있었던 배경에는 컴퓨터와 반도체의 성능향상과 인터넷에 널린 빅데이터의 도움이 결정적이다.

2012년 스탠포드 대학의 앤드류 응 교수와 구글이 함께 한 딥 러닝 프로젝트에서는 1만6000개의 컴퓨터 프로세서와 10억 개 이상의 신경망과 딥러닝을 이용하여 유튜브에 업로드 되어 있는 천만 개 넘는 비디오 중 고양이 인식에 성공하였다.

이 딥러닝에는 입력층(Input layer)과 출력층(Output layer) 사이에 여러 개의 은닉층(Hidden layer)들로 이루어져 있다. 이 딥러닝은 복잡한 비선형 관계(Non-linear relationship)들을 모델링할 수 있다.

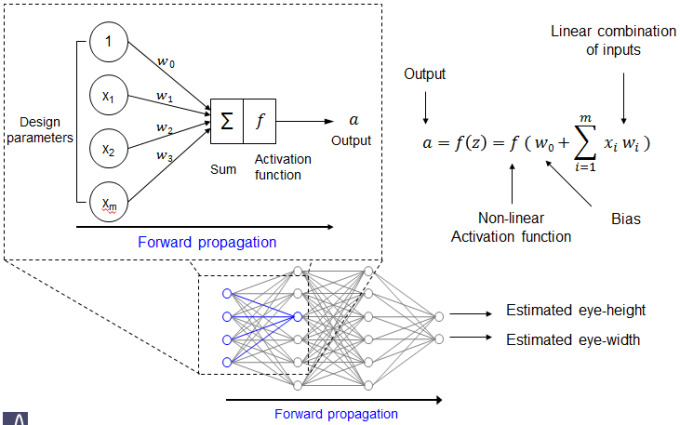

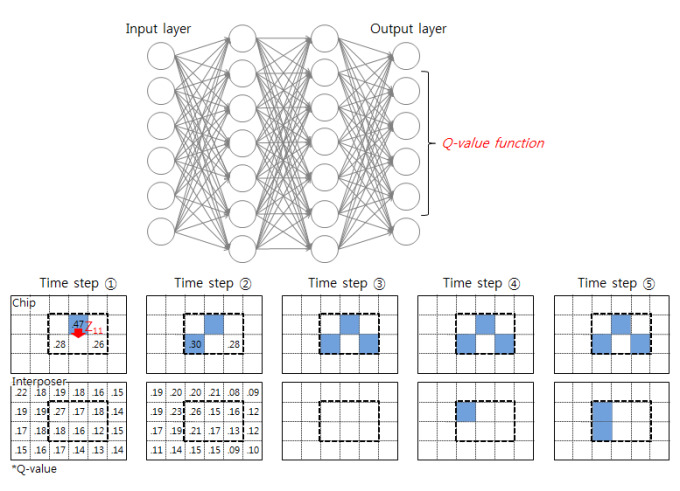

뇌의 동작은 비선형적이기 때문이다. 이 딥러닝 알고리즘에는 각 층에 설치된 수천 혹은 수천 만개의 신경세포(Node)가 서로 연결망의 선으로 연결되어 있다. 그리고 이 연결망을 통해서 각 층을 지나면서 출력이 전달될 때, 가중치(w, weight)가 곱해진다. 이때 각 신경세포(Node)에서 입력 값이 합해지게 되는데, 그 합이 일정 값이 넘으면 다음 단계로 출력으로 전달된다. 그래서 딥러닝 신경망에는 수많은 변수(Parameters)가 존재한다. 이러한 변수들은 인공지능이 빅데이터를 이용해 학습하면서 정해간다. 다름 아니라 이 변수들을 정해가는 과정을 학습이라고 한다.

이 학습과정에서 최종 출력 값인 결과와 미리 정해진 정답과 비교하면서 변수를 학습해 간다. 예를 들어 인공지능이 사진을 판독한다면, 입력이 사진이고 최종 출력이 판독이다. 사진을 넣어 주면서 결과를 뽑아 호랑이인지 고양이 인지 판정하게 되는데, 이 과정을 전진방향 전파 학습(Forward Propagation) 이라고 한다. 이 결과에 오차가 생겼을 때, 그 결과의 차이를 보고, 다시 꺼꾸로 변수를 정해가는 과정을 역방향 전파 학습(Back Propagation) 이라고 한다. 이처럼 결과 오류의 차이를 이용해 변수를 정해서 전해간다. 이렇게 답을 알려주면서 학습하는 방법을 지도학습(Supervised Learning) 이라 한다.

이렇게 인공지능에서 학습을 통해서 정해진 변수 값들을 행렬이나 테이블로 쭉 나열해 볼 수 있다. 그런데 놀랍게도 그 숫자들의 의미를 전혀 찾을 수가 없다. 인간에게 단순한 숫자의 나열에 불과하다. 그 숫자의 의미를 찾아 보려고 노력하지만 그 의미를 찾을 수 없다. 그래서 필자는 "설명 가능한 인공지능은 없다"고 말한다.

인공지능 작동원리, 아직은 설명 가능하지 않아

미국 국방성 고급 연구기관인 DARPA(Defense Advanced Research Projects Agency)는 방위 고등 연구 계획국의 약자이며, 미국 국방성의 연구, 개발 부문을 담당하고 있다. 인터넷의 원형을 개발한 것으로 잘 알려져 있다. 이 DARPA에서 인공지능을 이해하고 설명해 보려는 프로젝트를 진행하고 있다.

인공지능이 인간을 대신해서 전쟁을 수행하고 공격한다면 인간에게 매우 위협적이다. 핵 무기보다 무섭다. 잘못하면 인류의 종말이 가까이 올 수 있다. 그래서 국방 무기에 인공지능을 적용할 때 많은 우려를 갖는다. 이러한 배경으로 미국 국방부에서는 인공지능을 충분히 신뢰하기 위해서는 인공지능 내부와 결정과정을 이해하고 설명할 수 있어야 한다고 보는 것이다. 그런데 필자는 성공할 수 없는 프로젝트라고 본다.

인공지능은 수많은 데이터로 학습한 이후, 호랑이와 고양이 사진을 구별할 수 있다. 그런데 왜 그런지 인공지능 내부를 설명할 수 없다. 그리고 미래 인공지능은 쌍둥이도 구별하고, 같은 사람이 나이 들어도 알 수 있다. 가족도 찾아 낸다. 화장하더라도 같은 사람을 찾아 낼 수 있다.

이러한 구분은 '인간 아기'가 2~3세만 되어도 호랑이와 고양이 사진을 구별해내는 것과 유사하다. 방향이 돌려지고, 조명이 바뀌어도 찾아 낸다. 그런데 아기가 설명할 수는 없다. 설명할 수 없는 직관으로 찾아 낸다. 그래서 인공지능 내부는 직관이자 블랙박스이다.

인공지능, 신의 언어일까? 외계인의 언어일까?

인공지능에서 충분한 데이터로 학습하면 내부는 모르지만 입력을 하면 정답이 나오고 최적 값이, 그리고 판정이 나온다. 그래서 필자는 ‘인공지능이 신의 언어 혹은 외계인 언어’일수도 있다고 본다.

당분간 이해하거나 설명하려는 인간의 노력은 무의미하다. 어쩌다 반도체와 컴퓨터가 성능이 발전하고, 데이터가 많아 지면서 알게 된 비밀일 것 같다. 인공지능은 인간과 외계인과의 대화 물꼬를 틀지도 모른다.

4차 산업혁명의 동력인 반도체가 양자역학 원리에 의해서 동작한다. 양자 역학도 불확실성에 기반하고 확률을 구하는 물리이다. 기존 인간의 확정적 경험 세계로는 절대 설명할 수 없다. 그냥 받아 들여야 한다.

양자적 불연속 에너지 현상, 존재의 불확실성, 배타성 (Exclusion Principle) 등은 인간의 실 생활에서 찾아 볼 수 없다. 원자 세계에서만 나타나는 현상이다. 그래서 양자역학과 인공지능 모두 미지의 세계이고 상상의 세계이다. 4차 산업혁명 개념과 실제도 그래서 어렵다. 그 물결을 받아 들이고 파도를 타야 한다.

joungho@kaist.ac.kr

[김정호 카이스트 전기 및 전자공학과 교수]

영상

영상