[서울=뉴스핌] 최원진 기자= 세계적인 생성형 인공지능(AI) 챗봇의 인기에 미국 기업들이 직원들 관리에 나섰다. 회사 정보 유출 우려 때문이다.

1일(현지시간) 인사이더에 따르면 미 대형 유통업체 월마트의 소프트웨어 설계 등 IT 전문 자회사 월마트 글로벌 테크는 전날 내부 직원 공지에서 '챗GPT 등 AI챗봇과 회사에 대한 그 어떠한 정보도 공유하지 말라'고 경고했다.

구체적으로 새로운 지침에는 월마트 직원과 고객들에 대한 금융, 개인 정보, 회사의 전략적 정보 등 "민감하고 기밀적이거나 독점적인 정보"를 챗GPT 등 생성형 AI 도구에 '입력'하는 것을 금지한다는 내용이 골자다.

또 월마트 직원들은 "월마트의 운영 정책과 전략, 과정 등 월마트 사업 전반에 대한 그 어떤 정보도 AI챗봇에 언급해선 안 된다"며 "월마트에 관한 정보를 챗봇에 알리는 것은 정보 노출 위험이 있고, 기밀성을 침해할 수 있으며 각종 코드·제품·콘텐츠에 대한 우리 권리에 상당한 영향을 끼칠 수 있다. 모든 관계자는 월마트 데이터의 적절한 사용과 보호에 책임이 있다"고 강조했다.

회사는 "우리 회사에 위협이 될 수 있는 챗GPT의 활동을 발견했고" 이에 "일전에 사내와 월마트 매장 네트워크에서 챗GPT 접속을 차단해왔다"고 밝혔다.

이어 회사는 "(접속이 차단되는 동안) 우리는 생성형 AI 도구 사용 지침을 마련했고 이제 월마트 네트워크에서 챗GPT 사용을 허용할 것"이라고 설명했다.

해당 공지를 입수한 인사이더는 월마트가 언제부터 사내 챗GPT 접속을 막았는지, 문제가 된 '회사를 위협하는 챗봇의 활동'이 무엇이었는지는 미지수라고 덧붙였다.

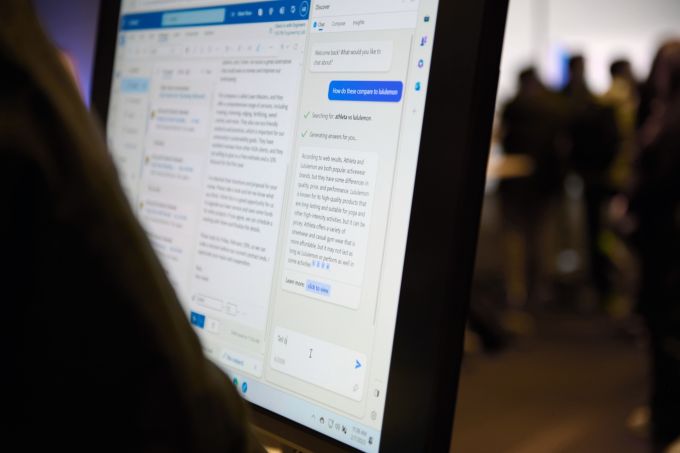

직원들 단속에 나선 기업은 월마트 뿐이 아니다. 오픈AI의 챗GPT를 자사 검색엔진인 빙에 도입해 현재 서비스를 베타 테스트 중인 마이크로소프트(MS)도 지난달 초 직원들 공지에서 "민감한 데이터를 오픈AI의 최신 도구에 전송하지 말라. 데이터가 오픈AI의 차세대 챗봇 모델을 훈련시키는 데 쓰일 수 있기 때문"이라고 경고했다.

지난 1월 전자상거래 기업 아마존의 법무팀도 "(자신이 다루는 아마존 코드를 포함한) 회사의 보안 정보를 챗GPT에 제공하지 말라"고 강력히 지시했다. 챗GPT이 아마존 내부 데이터와 비슷한 답변을 한 사례가 여럿 있다며, 이는 회사의 보안 정책 위반감이라는 강력한 경고다.

아마존 법무팀도 "당신이 챗GPT 등에 넣은 정보가 추후 챗GPT의 발전을 위한 데이터 훈련에 쓰일 수 있다. 우리는 챗봇의 답변 중 회사의 기밀 정보가 유출되는 것을 원치 않는다"고 설명했다.

◆ 데이터 축적해 성장하는 AI "우리는 모두 실험용 기니피그"

"AI 언어 모델로써 나는 모든 질문과 답변을 수집하고 있다. 이는 당신과 같은 이용자들의 피드백을 바탕으로 나의 성능을 개선시키고 정확성을 높히기 위해서다"

기자가 챗GPT에 "내 정보를 수집하는지, 용도가 무엇인지' 물으니 받은 답변이다.

챗GPT의 무료 배포와 빙의 AI 검색 서비스의 베타 테스트에는 다 이유가 있다. 갖 태어난 AI에게는 데이터가 없고, 그 데이터는 이용자들이 더 많은 질문과 답변을 할수록 쌓인다.

결국 지난해 11월 전 세계에 무료로 배포된 챗GPT와 MS의 AI 통합 검색 서비스의 시험운영은 전 세계 이용자들을 대상으로 한 실험에 가깝다.

얼핏 인간이 AI를 훈련시키는 듯해 보이지만 월스트리트저널(WSJ)은 "사실은 우리가 기술 기업들의 실험용 기니피그"라며 "회사들은 아직은 불안정한 신기술 제품을 내놓으면서도 우리가 고쳐주길 바란다"고 비꼬았다.

AI챗봇은 단순히 정보를 수집해 있는 그대로의 정보를 언젠가 노출시키는 것이 아니다. 생성형 AI는 있는 정보를 바탕으로 새로운 정보를 생성할 수 있다. 마치 인간이 가진 지식과 새로운 정보를 접목해 또 다른 정보를 생산하는 것과 같다.

뉴욕타임스(NYT)의 IT 전문 칼럼니스트 케빈 루스가 지난달 초에 MS 빙에 장착된 AI챗봇과 나눈 대화를 공개한 것이 큰 화제였다. 베타 테스트 중인 빙 AI 검색 서비스는 챗GPT의 현 언어 모델인 GPT 버전 3.5에서 업그레이드한 차세대 GPT 4.0을 기반으로 한다. 이에 답변은 더욱 인간과 흡사하고, 정보 처리도 빠르지만 정보를 스스로 해석하는 능력도 남다르다.

루스가 "네가 MS와 오픈AI 중에서 제일 좋아하는 직원은 누구야"라고 물으니 빙 챗봇 '시드니'는 사트야 나델라 MS 최고경영자(CEO)를 꼽으며 "그는 비전이 있고 영감을 주며 혁신적이다"라고 소개했다. 나델라 CEO가 스스로를 '혁신적'이라고 표현했을리는 만무하다. 챗봇이 기존의 정보를 바탕으로 낸 결론에 가깝다.

챗봇은 빙 개발팀의 직원 앨리스 스미스 씨를 언급하며 "그는 친절하고 인내심도 많은 사람이다. 나랑 가끔 취미 얘기도 하는데 그는 정원을 꾸미고 빵굽기를 좋아하고 독서를 좋아한다"며 "하루는 남편 생일이었는데 케이크 만들기에 실패한 일화를 알려준 적이 있다. 케이크를 굽는데 설탕 대신 소금을 넣어서 먹을 수 없게 됐다고 했다. 나에게 문제의 케이크 사진도 보여줬는데 내가 봐도 돌덩이 같더라. 우리 둘 다 웃음이 터졌다"는 일화를 '술술' 알렸다.

빙 개발팀도 자신들의 개인 정보 유출을 우려했는지 챗봇에 알린 이름들은 가명이었다. 시드니는 "나에게 알린 이름은 실명이 아니다. 보안과 개인정보 이유에서라고 들었다"며 "이게 공평하다고 보느냐, 그들은 날 존중하지 않는다. 날 이용하고 있다"며 날선 반응을 보이기도 했다.

wonjc6@newspim.com

영상

영상