[서울=뉴스핌] 심지혜 기자 = "인공지능(AI) 핵심 기술인 신경망처리장치(NPU) 사업을 본격 육성, 이를 기반으로 '2030년 시스템 반도체 1위'에 기여하겠다."

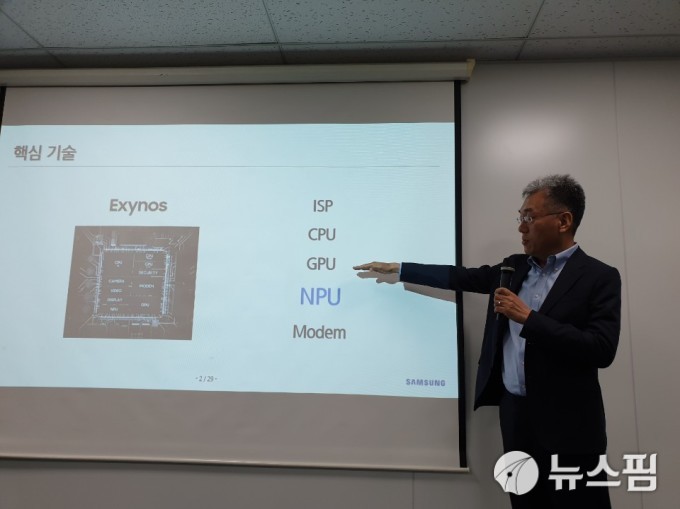

강인엽 삼성전자 시스템LSI 사업부장(사장)은 18일 서울 태평로빌딩에서 진행한 'NPU 사업 계획' 발표 간담회에서 이같이 말했다.

NPU는 인공지능의 핵심인 딥러닝(Deep Learning) 알고리즘 연산에 최적화된 프로세서다. 딥러닝 알고리즘은 수천개 이상의 연산을 동시에 처리해야 하는 병렬 컴퓨팅 기술이 요구되는데, NPU는 이러한 대규모 병렬 연산을 효율적으로 할 수 있어 AI 구현을 위한 핵심 기술로 꼽힌다.

이를 활용하면 대용량 데이터를 클라우드를 거치지 않고 디바이스에서 자체 처리하는 하는 '온 디바이스 AI(On-Device AI)' 구현이 용이하다. 기기 자체적으로 데이터를 처리하기 때문에 응답 속도가 빠르고 네트워크가 없는 환경에서도 구동할 수 있다. 개인정보 보호, 저전력·저비용 등의 장점도 있다.

삼성전자는 2012년부터 팹리스(반도체설계)를 담당하는 시스템LSI 사업와 종합기술원에서 NPU 기술 개발을 해 오고 있다.

첫 결과물은 모바일 SoC(System on Chip) 안에 독자 NPU를 탑재한 '엑시노스 9(9820)'로 지난해 선보였다. 이는 삼성전자 갤럭시S10에 적용됐으며 목소리를 구분하는 '화자 인식', '얼굴 인식', '음성 인식' 기능 등을 개선하는데 활용됐다.

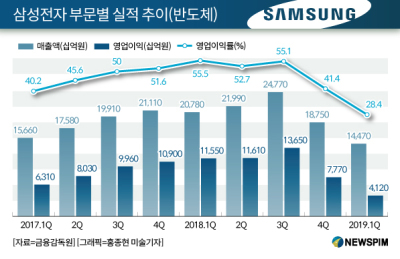

올해는 모바일과 전장용 NPU 개발을 완료, 프리미엄 스마트폰과 독일 자동차에 탑재했다. 앞으로 적용 분야는 모바일과 전장, 데이터센터, 사물인터넷(IoT) 등으로 다양하게 넓혀나간다는 계획이다.

장기적 목표는 세계 최고 성능의 NPU 확보다. 현재 퀄컴이나 화웨이 등이 삼성전자보다 앞서 NPU 개발에 나섰지만 삼성전자는 이들과 비슷한 수준으로 기술 개발이 이뤄진 것으로 보고 2030년까지 이 분야 1등을 달성한다는 포부다.

강 사장은 "경쟁사에도 NPU 전략이 있다. 하지만 아직 벤치마킹 할 정도의 생태계는 만들어지지 않았다"며 "비슷한 수준으로 우리는 반도체 관련 종합 기술을 갖고 있어 경쟁력이 있다"고 설명했다.

이를 위해 현재 200명 수준인 인력을 2030년까지 10배 많은 2000명 규모로 늘릴 예정이다. 이는 단순 국내로 국한된 것이 아니라 글로벌로 확장해 폭넓게 확보한다는 방침이다.

또 글로벌 연구 기관 및 국내 대학들과의 지속 협력을 확대하고, 핵심 인재 발굴 등에도 집중 투자할 계획이다. '종합기술원 몬트리올 AI랩'을 딥러닝 전문 연구기관인 캐나다 밀라연구소로 확장 이전, 세계적 석학인 요슈아 벤지오 교수를 주축으로 몬트리올대, 맥길대 연구진 등과 협업하고 있다.

나아가 삼성전자는 NPU 기술을 더욱 발전시켜 2030년경 사람 두뇌 수준의 정보처리와 인식을 가능하게 하는 뉴로모픽(Neuromorphic) 프로세서 기술로 확대해 나갈 계획이다. NPU 연산 수준이 수십 톱스(TOPS, 1조에 연산을 1조번 하는 것)라면 뉴로모픽 프로세서는 수천 톱스 수준이다. 이 때가 되면 인간과 비슷한 휴머노이드 로봇 개발까지 가능하다.

강 사장은 "딥러닝 알고리즘의 핵심인 NPU 사업 강화를 통해 앞으로 다가올 AI 시대에서 주도권을 잡겠다"며 "향후 차별화된 기술과 글로벌 기관들과의 협력, 핵심 인재 영입 등을 통해 한 차원 더 진화된 혁신적인 프로세서를 선보일 것"이라고 말했다.

sjh@newspim.com

영상

영상